به گزارش خبرگزاریها، اینستاگرام به تازگی اعلام کرده که در صورت جستجوی محتوای خطرناک توسط نوجوانان، به والدینشان هشدار خواهد داد. شرکت متا، با راهاندازی این طرح، هدفش آگاهسازی خانوادهها از مشکلات روحی پنهان فرزندانشان است. اما برخی از نهادهای خیریه و حامی حقوق کودکان معتقدند که این اقدام بیشتر به معنای کاهش مسئولیت متا است و نمیتواند به حل مشکلات کمک کند.

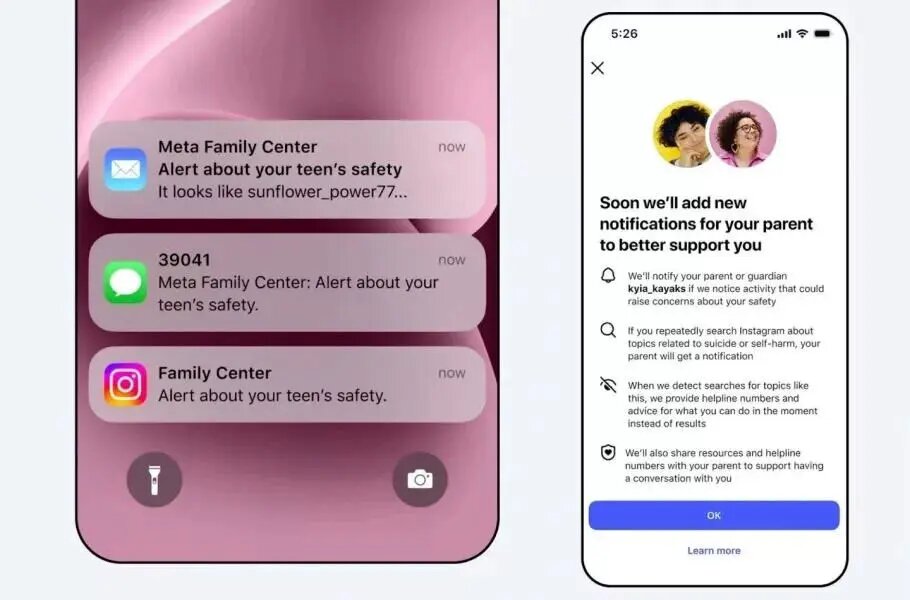

بر اساس گزارشها، اینستاگرام در صورتی که نوجوانان بهطور مکرر کلمات مرتبط با خودکشی یا خودآزاری را جستجو کنند، هشدارهایی را برای والدینشان ارسال خواهد کرد. این قابلیت از هفته آینده برای حسابهای کاربری نوجوانان در کشورهای آمریکا، بریتانیا، استرالیا و کانادا فعال میشود.

مدیران اینستاگرام توضیح دادند که این ابزار تنها برای خانوادههایی قابل استفاده خواهد بود که قبلاً سیستم نظارت والدین را فعال کردهاند. متا برنامه دارد تا این سیستم را تا پایان سال جاری به دیگر نقاط جهان نیز گسترش دهد. در حال حاضر، این پلتفرم محتوای مضر را مسدود و کاربران را به منابع حمایتی هدایت میکند، اما این اولین بار است که بهطور پیشگیرانه اطلاعاتی به والدین ارسال میشود.

شرکت متا این هشدارها را بر اساس اطلاعات تماس ثبت شده، از طریق پیامک، ایمیل، واتسآپ یا اعلانهای درونبرنامه ای به والدین اطلاعرسانی میکند. بهعلاوه، منابع آموزشی و مشاورههای تخصصی نیز در اختیار خانوادهها قرار میگیرد تا گفتوگوهای دشوار با فرزندانشان را تسهیل کنند.

این سیستم جدید بهطور محتاطانه عمل میکند و ممکن است هشدارهایی صادر کند حتی در مواقعی که خطر فوری وجود ندارد، تا ایمنی کاربران نوجوان به بهترین شکل ممکن تضمین شود.

با این حال، این ویژگی با انتقادات نیز مواجه شده است. “اندی باروز”، مدیرعامل بنیاد خیریه مولی رز، هشدار میدهد که این اخطارهای ناگهانی ممکن است تنها به ترس والدین منجر شود و متا به جای این اقدامات، باید به اصلاح الگوریتمهای خود بپردازد. بنیاد مذکور پس از خودکشی دختر ۱۴ سالهای بهنام مولی راس تأسیس شده است که پیش از مرگ محتوای مربوط به خودآزاری را در اینستاگرام مشاهده کرده بود. باروز بر این باور است که اینستاگرام همچنان محتوای مرتبط با افسردگی و خودکشی را به جوانان پیشنهاد میدهد.